.jpg)

HMI, CAR.HMI CONFERENCE, TRENDS

Revolutionierung der Fahrzeuginteraktion: Erforschung der Zukunft von HMIs auf der car.HMI-Konferenz 2023

Entdecken Sie die Zukunft der Fahrzeuginteraktion und die Leistungsfähigkeit intuitiver HMIs in dieser Zusammenfassung unserer Erfahrungen auf der car.HMI-Konferenz. Zu den wichtigsten Themen gehörten die zentrale Rolle der Nutzererfahrung, innovative Konzepte für das autonome Fahren, UI-Showcases auf Basis von Android Automotive OS und das Potenzial von KI bei der Weiterentwicklung von HMIs. Von der Erkennung von Fahreremotionen bis hin zu fortschrittlichen Gesteninteraktionen - diese Veranstaltung hat uns spannende Möglichkeiten für die Zukunft aufgezeigt.

5

MIN

Jul 12, 2023

Mitte Juni nahm unser Team an der 2023 Conference car.HMI in Berlin teil, einer Veranstaltung, die viele interessante Einblicke in die Themen intuitive Fahrzeuginteraktion und die Zukunft der Mensch-Maschine-Schnittstelle (HMI) bot. Wir fassen hier zusammen, was wir als die wichtigsten Eindrücke empfunden haben.

In vielen Vorträgen wurde die zentrale Rolle der Benutzererfahrung (UX) für die Mensch-Maschine-Schnittstelle (HMI) von den Rednern hervorgehoben. Da Autos immer stärker vernetzt und anpassbar sind, gewinnen die HMI und ihre UX sowohl für die Kundenzufriedenheit als auch für die Markenwahrnehmung an Bedeutung.

Die car.HMI-Konferenz wurde mit der InCabin Sensing-Konferenz kombiniert, die unser Team als besonders anregend empfand. Durch die vielen thematischen Berührungspunkte förderte diese Vertiefung viele innovative Ideen und neue Perspektiven, die aufzeigten, wie Sensortechnologie im Auto auf wirkungsvolle Weise eingesetzt werden kann.

AUTONOMES FAHREN

Es überrascht nicht, dass der Bereich des autonomen Fahrens ein großes Thema war. In einigen Exponaten und Vorträgen wurden verschiedene Konzepte vorgestellt, wie der Fahrer in den verschiedenen Zuständen des automatisierten Fahrens auf dem Laufenden gehalten werden kann. Dabei wurden verschiedene Implementierungen von multimodalen Rückmeldungen und Warnungen empfohlen, die die aktuelle Situation nicht nur visuell, sondern auch haptisch und akustisch vermitteln sollen.

Darüber hinaus wurden in vielen Präsentationen Head-Up-Displays (HUDs) und Augmented-Reality-Konzepte (AR) für das automatisierte Fahren vorgestellt. Besonders gut gefiel uns die Präsentation von Basemark, die die Fähigkeit ihrer Technologie zeigte, Informationen nahtlos in die Live-Ansicht der Situation zu integrieren, ohne den Fahrer abzulenken oder wesentliche Informationen der realen Umgebung zu verdecken.

ANDROID AUTOMOTIVE

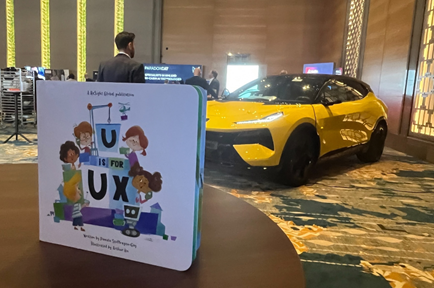

Darüber hinaus gab es wieder viele Konzepte für Benutzeroberflächen (UI), die auf dem Android Automotive OS basieren, zu sehen. Der neue Eletre von LOTUS, ein batterieelektrisch betriebenes Sport Utility Vehicle (SUV), wurde ausgestellt, und wir konnten das UI-Erlebnis direkt im Cockpit testen. Laut den Designern, mit denen wir sprachen, war das Designziel, jede wichtige Funktion mit 3 Klicks erreichbar zu machen. Dieser Ansatz, der zwar ansprechend ist, führte unserer Meinung nach zu einer sehr gestapelten Informationsarchitektur, die einen unübersichtlichen Eindruck hinterließ. Die Darstellung enthielt auch viele visuelle Elemente, die keinem Interaktionszweck dienten, was einen offensichtlichen Fokus von LOTUS auf ostasiatische Märkte vermittelte. Aus unserer Sicht könnte dies zu einer langsameren Akzeptanz in Regionen führen, in denen ein minimalistischerer Ansatz bei der Oberflächengestaltung üblich ist.

KI-ANWENDUNGEN IN ZUKÜNFTIGEN FAHRZEUGEN

Ein weiteres wichtiges Thema waren die vielfältigen Möglichkeiten, die die künstliche Intelligenz (KI) zur Verbesserung der Mensch-Maschine-Schnittstelle bietet. Mehrere Aussteller zeigten Beispiele dafür, wie KI eingesetzt werden kann, um die Erfahrung der persönlichen Assistenz zu verbessern oder die HMI entsprechend den Bedürfnissen des Fahrers zu personalisieren. Ein Konzept, das unsere Aufmerksamkeit erregte, war eine von Luxoft entwickelte KI-basierte Funktion, die es ermöglichte, einen individuellen Hintergrund für das zentrale Informationsdisplay (Central Information Display, CID) mit Hilfe von Sprachanweisungen zu erstellen und dann automatisch Layout, Farbe und Schriftart der Benutzeroberfläche entsprechend anzupassen.

ERKENNEN VON EMOTIONEN BEIM FAHRER

Die Erkennung des emotionalen Zustands des Fahrers während der Fahrt wurde ebenfalls thematisiert. Es wurden mehrere Aufbauten und Anwendungen gezeigt (z. B. von Fraunhofer), bei denen Kameras den Gesichtsausdruck des Fahrers erfassen und diese Informationen mit Daten von verschiedenen Sensoren für Puls, Bewegung oder Lenkverhalten kombinieren.

Luxoft stellte einen innovativen Ansatz für das Training solcher Systeme vor, bei dem computergenerierte Gesichter für das Training der KI verwendet werden. Dies könnte ein viel schnelleres und genaueres Training ermöglichen, als wenn man sich auf menschliche Testpersonen verlassen müsste.

Ein weiteres interessantes Konzept waren die von Infineon vorgestellten time-off-flight Sensoren, die eingesetzt werden können, um den intelligenten Einsatz von Airbags oder fortschrittliche Gesteninteraktion zu ermöglichen.

BIS ZUM NÄCHSTEN JAHR 🚀📅

Die car.HMI war eine fantastische Veranstaltung, und das uintent-Team war begeistert, dass es die Möglichkeit zum Austausch mit anderen Branchenexperten hatte. Vielen Dank an die Organisatoren für die Ausrichtung einer so bemerkenswerten und zum Nachdenken anregenden Veranstaltung!

%20.webp)